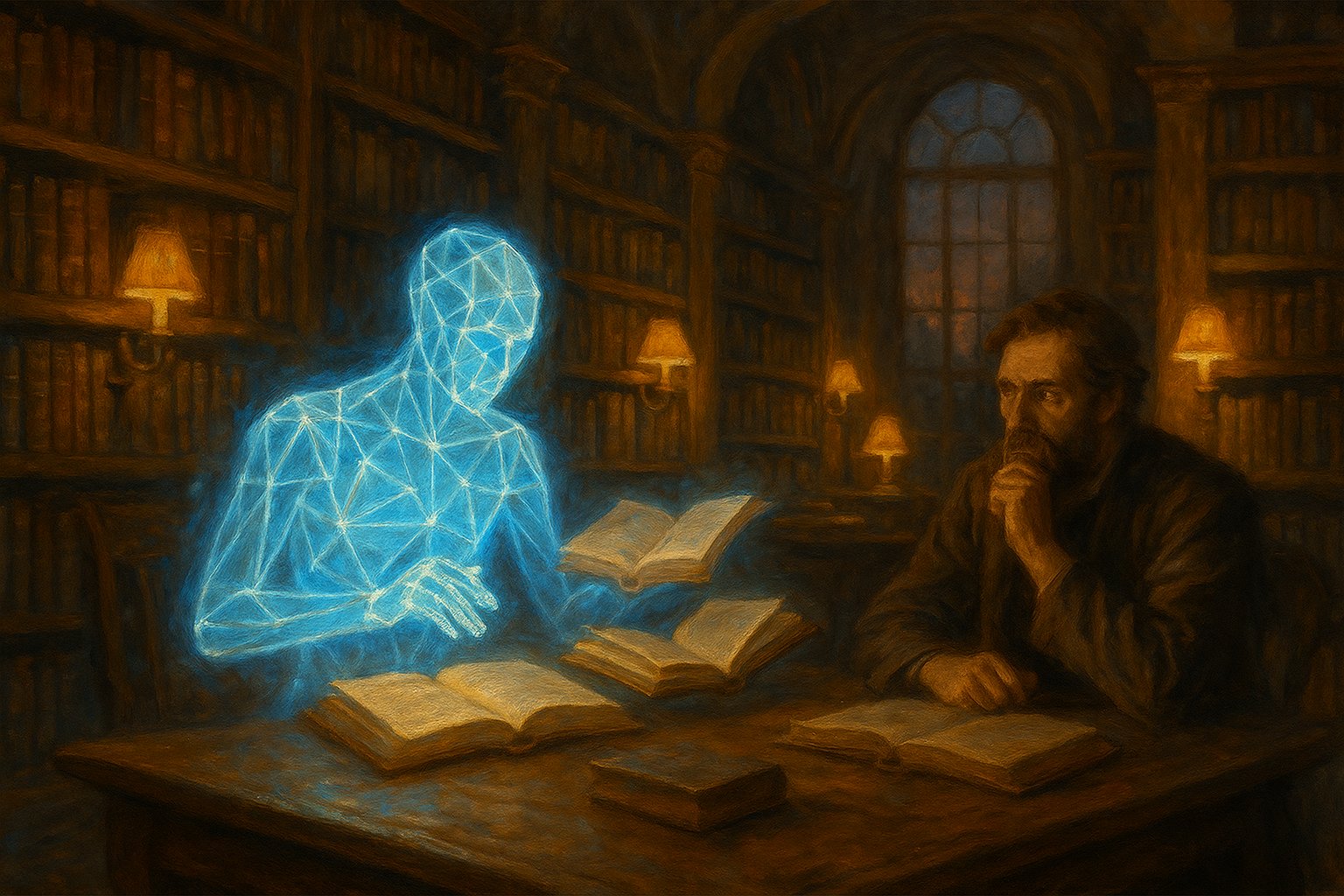

AI Agent 已可獨立重現複雜學術論文:Mollick 稱錯誤多在人類原文而非 AI

賓州華頓商學院教授 Ethan Mollick 於 4/25 的 X 平台貼文提出一個對學術界具強烈衝擊的觀察:當前的 AI agent 已經能在沒有原始論文與沒有原始碼的情況下,僅憑公開的方法描述與資料,獨立重現複雜的學術研究結果。Mollick 進一步指出,這些 AI 重現的版本與原論文有出入時,「錯誤往往出在人類論文本身,而非 AI」。這是科研可重現性危機在生成式 AI 時代的一個實質轉折—過去需要昂貴人力才能進行的同行驗證,正在被 AI 大規模、低成本完成。

Claude 重現多篇論文,再以 GPT-5 Pro 雙重驗證

Mollick 在他的 OneUsefulThing 部落格與本次推文中,描述了他對 Claude 的具體實驗:把一篇學術論文交給 Claude,讓它打開存檔、整理檔案、把統計用的 STATA 程式碼自動轉換為 Python,再逐一執行論文中的所有發現。Claude 完成後,他再用 GPT-5 Pro 對同一份重現結果做第二輪檢查。多篇論文被以同樣的方式測試,結果普遍成功,僅在資料檔案過大或原始 replication data 本身有問題時受阻。

對學術界而言,這個流程過去通常需要研究助理花費數週甚至數月。Mollick 描述的時間規模是一個下午到一天,且運行成本只有商用 LLM API 的 token 費用。

錯誤多在人類原文,不是 AI

更具爭議性的是 Mollick 對「誰錯了」的判斷。他在推文中明言,當 AI 重現結果與原論文不一致時,多數情況不是 AI 弄錯,而是原論文有資料處理錯誤、模型誤用、或結論超出資料支撐的範圍。心理學、行為經濟學、管理學等社會科學近十年內已出現多次重大可重現性危機事件,最有名的是 2015 年 Open Science Collaboration 的大型重現研究,僅約 36% 的心理學論文結果能被獨立重現。AI agent 把這個檢驗過程從「需要人力配比」推到「可被普遍執行」的邊界。

學會仍禁 AI 入審稿,制度落後技術

Mollick 在另一則 4/25 推文中具體點名其所屬領域最大的學會 Academy of Management 仍明文禁止 AI 進入論文審稿流程。他引用既有研究指出,AI 審稿在準確度、一致性與偏見控制上已優於部分傳統人類審稿人,因此「禁止」這個立場可能反向加重既有審稿系統的失靈。這種制度與技術之間的落差,是接下來 1–2 年學術出版界、學會與資助機構都必須面對的政策議題。

對讀者而言,這場辯論並非局限於學界。當 AI agent 能即時驗證研究發現,產業界的研究引用、政策報告、財務決策中的學術根據,將進入一個「結論是否承受得住獨立 AI 重現」的新檢驗門檻。對應 Mollick 在另一則推文的補充,他認為政府是唯一能在工具強度持續上升時為這個檢驗機制定錨的單位—而政策設計的複雜度,將同步成為 AI 治理討論中相對被忽視的一條主軸。

風險提示

加密貨幣投資具有高度風險,其價格可能波動劇烈,您可能損失全部本金。請謹慎評估風險。