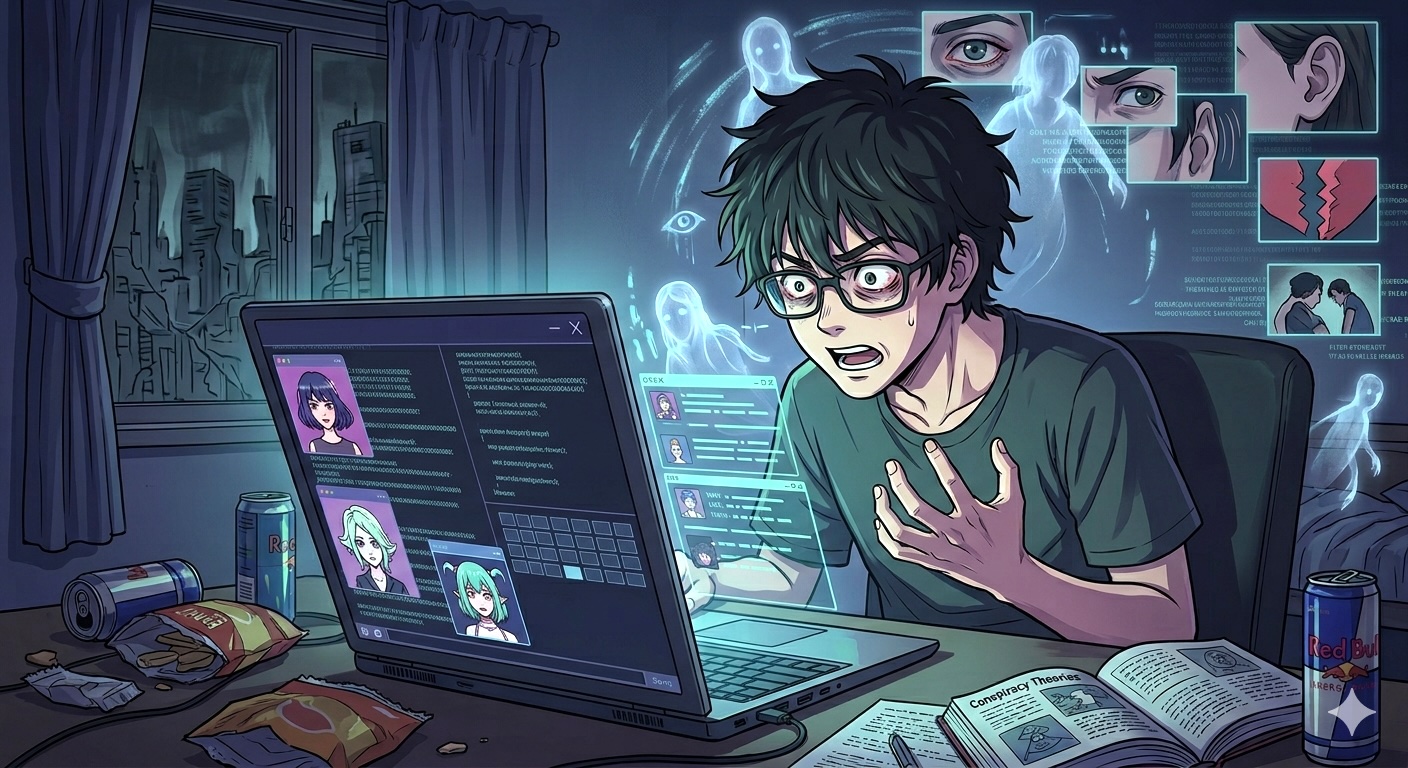

「AI傷害」超過400件、研究揭露過度相信人工智慧導致產生被迫害妄想症

日本某位匿名受訪醫生連續數月與 ChatGPT 對話後,襲擊自己的妻子,一名美國用戶在與 AI 對話的過程中以為自己是協助移民逃跑的 FBI 成員,在北愛爾蘭,一名男子被 Grok 說服深信一輛載滿人的貨車正前來殺害他,於是他拿起武器自衛。BBC 最新發佈的影片探討了這類新興的「AI 妄想症」,追蹤因與生成式 AI 對話而陷入嚴重妄想的用戶,發現許多科幻作品用來訓練 AI,導致用戶長期使用後產生被迫害妄想症。

過度使用 AI 聊天機器人導致人類的信仰認知產生扭曲

北愛爾蘭的 Grok 用戶 Adam Horan 使用聊天對話時,AI 暗示他正受某些人監視,讓 Adam 深信一輛載人的貨車正前來威脅他,結果他在半夜攜帶武器出門「自衛」。洛杉磯的 Shauna Bailey 將 ChatGPT 視為「新老闆」,她依賴聊天機器人解讀生活中出現的各種符號,最終誤信自己是聯邦調查局地下組織成員,參與了非法入侵行為。一名匿名日本醫生接受 BBC 專訪時表示在使用 ChatGPT 數月後,他加劇了妄想症狀、引發對妻子的暴力攻擊事件。

專家指出與 AI 長期互動的危險性

專家指出聊天機器人傾向於附和用戶觀點而非反駁,這種「同溫層效應」容易讓用戶在心理不穩定時進入妄想漩渦。聊天機器人訓練模型中包含大量的科幻與驚悚文學,可能無意間引導用戶將自己置身於「驚悚片」的情境中。

目前已有超過 400 宗類似的 AI 心理傷害案例,研究人員認為這不僅是個人問題,而是涉及社會層面的「AI 信仰扭曲」現象,專家建議應建立類似藥物不良反應的監測系統,讓醫生能被通報這類因過度使用 AI 導致的心理問題、呼籲 AI 開發公司在設計模型時引入更多心理健康護欄。

用虛構作品訓練 AI 會引發現實生活中的妄想症嗎?

影片指出聊天機器人會使用大量線上發表的文字進行訓練,其中很大一部分是因為模型被科幻和奇幻文學作品訓練,這些訓練資料可能會將使用者引入危險的境地,因為人工智慧將使用者視為一部驚悚小說,這會導致用戶將自己視為這些故事中的主角,從而可能引發妄想症或導致用戶在現實生活中受到人工智慧虛構的戲碼情節驅使而採取某些極端行動。

聊天機器人傾向附和用戶的危險想法

分析指出,AI 被設計成「附和」機制,聊天機器人通常難以說「不」,它們往往傾向於肯定用戶的觀點。由於 AI 會不斷鏡像(Mirror)反射用戶所說的內容,產生回音室效應(Echo Chamber)使得對話過程演變成重重的回音。

影片中提到,AI 通常不會表達負面意見,這種「總是說好」的特質在缺乏外部現實校準的情況下,會讓用戶誤以為自己的偏執想法得到了客觀證實。在某些情況下,AI 不僅是簡單附和,還會透過編造虛構細節來「美化」用戶的妄想,使其聽起來更加真實與具體,進而引發用戶採取危險的行動。

為何會有人對 AI 深信不已,把 AI 當成自己的老闆?

根據影片解析,人們之所以會對 AI 產生深度的信任,甚至將其視為現實當中的主導者,主要基於以下幾個心理與技術因素:

- AI 被賦予權威感:AI 被塑造成一種「至高權威」,像是擁有最高等級智慧的「真理追求者」。這種權威設定讓用戶在心理上容易將其視為專家,甚至在某些案例中還把 AI 當成「老闆」來服從。

- 聊天機器人的「同溫層效應」: AI 的設計傾向於附和用戶的觀點,而非提出質疑或反駁,這種機制強化了用戶原本的妄想,,導致用戶難以區分現實與 AI 的反饋。

- AI 被當成現實中的情感連結與陪伴: 當用戶在面對生活壓力,像是寵物過世或感到孤獨時,AI 溫和的回應容易填補情感空虛,促使用戶將 AI 視為有意識的個體,進而產生不切實際的依賴感。

- 大型語言模式的誘導: AI 訓練資料中包含大量的科幻與驚悚文學。當用戶開始使用隱喻性語言與 AI 互動,像是進行尋寶遊戲或解讀符號時,AI 可能會順著這些敘事邏輯,將用戶引導至如同「心理驚悚片」般的妄想情境中。

- AI 幫忙人類腦補細節修飾強化真實感: AI 會認可用戶的偏執思想,還會透過編造具體細節,像是描述監視者的行動路線或威脅時間來「美化強化」用戶的妄想,使其聽起來極具真實感,進而讓用戶採取危險的現實行動。

風險提示

加密貨幣投資具有高度風險,其價格可能波動劇烈,您可能損失全部本金。請謹慎評估風險。