NVIDIA GTC 2026|解析輝達百億併購 Groq 戰略,LPX 如何改變推論進程

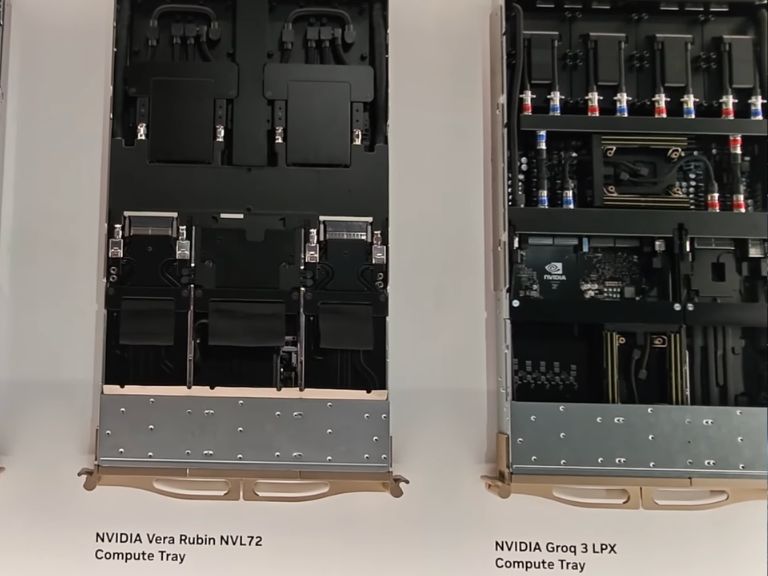

在輝達 GTC 2026 上,最受關注的不只是 Vera Rubin NVL72,更是與 Groq 3 LPX 搭配所形成的全新推論模式。AI 基礎設施正從單一 GPU 主導的運算模式,轉向以分工為核心的異質化架構。

Groq 3 LPX 被定位為專門處理低延遲推論的加速器,與 Rubin GPU 形成互補關係。在傳統架構中,GPU 必須同時負責處理長上下文輸入與逐 token 生成,隨著模型規模與上下文長度快速擴張,這種一體化設計逐漸出現效率瓶頸。

NVIDIA 因此將推論流程拆解,讓 Rubin GPU 專注於高吞吐的前處理與注意力計算,而 LPX 則負責最依賴即時反應的解碼階段,特別是前饋神經網路與 MoE 專家運算。輝達去年以約 200 億美元現金,取得 Groq 就是這個原因。Groq 主打專為 AI 推論設計的 LPU(Language Processing Unit) 架構,極低延遲、穩定回應時間與高能效,特別適用於即時對話、語音助理等場景。

(輝達史上最大併購案:斥資 6,400 億取得 Groq 技術與 Google TPU 之父)

GPU 協作 LPU 把推論拆開來做

這種被稱為「Disaggregated Inference」的設計,使推論過程不再由單一處理器完成,而是透過 GPU 與 LPU 之間的協同運作來完成。

實際運行時,模型會先在 GPU 上建立上下文與 KV cache,隨後在每一個 token 的生成循環中,由 GPU 處理 attention,再將中間結果交由 LPX 執行 FFN 計算,最後回傳 GPU 組合輸出。這種分工模式讓不同運算單元各自處理最擅長的部分,大幅提升整體效率。

輝達收購 Groq 將其 LPU 應用於 LPX

LPX 的核心在於其 LPU 架構。不同於 GPU 依賴動態排程與高頻寬外部記憶體,LPU 採用強調可預測性的設計,透過編譯器直接控制運算與資料流,降低延遲波動。其 SRAM-first 架構讓關鍵資料儘可能停留在晶片內部,減少記憶體存取帶來的不確定性,使每個 token 的生成時間更加穩定。這種特性對於即時互動型 AI 應用至關重要,因為延遲直接影響使用者體驗的產品特性。

LPX 機櫃規格公開,由 256 顆 LPU 組成

在硬體規模上,一個 LPX 機櫃由 256 顆 LPU 組成,具備極高的片上記憶體頻寬與晶片間通訊能力,專為低延遲推論設計。與 Rubin GPU 的高 FLOPS 與大容量記憶體形成對比,LPX 更像是一個專門為「最後一哩路」優化的引擎,負責將模型輸出轉化為即時可用的結果。

風險提示

加密貨幣投資具有高度風險,其價格可能波動劇烈,您可能損失全部本金。請謹慎評估風險。